脚注を含むフルバージョン(日本語版)はこちらからご覧ください。また、英語版はこちらからご覧ください。

本ニュースレターは、人工知能(AI)の規制に関する一連の記事の第一部です。本稿では、AIの利用その他の関連する問題に対応するための世界初の包括的な法的枠組みであるEU AI 法の概要を紹介いたします。

* 2025.2.27 最終改訂

I.はじめに:

欧州連合(EU)の人工知能法(「AI法」)が2024年8月1日に発効しました。これは、人工知能(AI)に関する包括的な法的枠組みを世界で初めて定めた法律であり、欧州内外でAIの信頼性を促進することを目的としています 。AI法はEU指令ではなくEU規則の形で採択されたため、EU加盟国に直接適用されます。その目的を達成するため、AI法は「リスクベースアプローチ」を採用し、AIの提供者と利用者に、特定されたリスクのさまざまなレベルに応じた要件と義務を定めています。AI法の適用範囲が広範であることを考慮すると、EU域内でAIシステムを開発、創造、利用、またはそうしたサービスを提供する日本企業にとって、AI法は重大な影響を及ぼす可能性があります。

II.AI法の範囲:

一般的な範囲:

AI法は、一般に「AIシステム」に適用されます。「AIシステム」とは、「様々なレベルの自律性で動作するように設計され、配備後に適応性を示す可能性があり、明示的または黙示的な目的をもって、物理的または仮想的な環境に影響を及ぼすことができる予測、コンテンツ、提案、または決定などのアウトプットを生成する方法を、受信したインプットから推測する機械ベースのシステム」と定義されています 。

AI法は、以下のとおりAIエコシステム全体における複数の事業者を広くカバーしています :

-提供者(Provider):有償・無償を問わず、自社名や商標でAIシステムを市場に出したり、サービスを開始したりするAIシステムや汎用目的AIモデルを開発する者。

-利用者(Deployer):事業の一環として、自らの権限でAIシステムを利用する者。

-輸入者(Importer):EU域内に所在または設立され、EU域外に設立された自然人または法人または商標が付されたAIシステムを市場に投入する自然人または法人輸入者。

-流通事業者(Distributor):AIシステムをEU市場で販売する者(ただし、提供者や輸 入者を除く)。

AIシステムに加えて、AI法は以下に説明する「汎用AIモデル」(GPAIモデル)も規制しています。

域外適用性:

上記のように、AI法はAIエコシステム全体のAI事業者を広くカバーし、EUの地理的国境を越えて適用される可能性があるため、(GDPRと同様に)グローバルな適用範囲となる可能性があります。AI法は、以下の2つの場合において第三国に設立されたAIシステムの提供者や利用者にも適用されます 。:

-提供者が、EU域内において、AIシステムを市場に投入したり、サービスを開始したり、汎用AIモデルを市場に投入したりする場合。

-AIシステムの提供者および利用者が、そのシステムによって生成されたアウトプットをEU 域内で利用する場合。

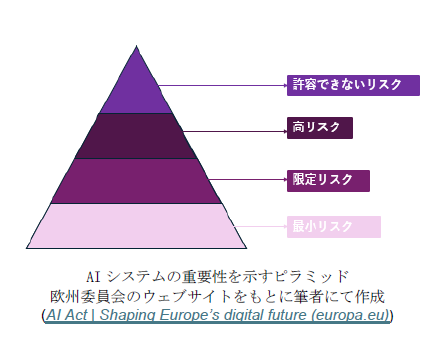

III.リスクベースのアプローチ:

AI法は、AIシステムを規制するためにリスクベースアプローチを導入しており、AIシステムがもたらす健康、安全、基本的権利に対するリスクの度合いに応じて異なる要件と義務を課しています。AIシステムは、リスクの度合いに応じて以下の4つに分類されます:

(a)「許容できないリスク」のAIシステム

(b)「高リスク」のAIシステム

(c)「限定リスク」のAIシステム

(d)「最小リスク」のAIシステム AI法の大部分において、「高リスク」のAIシステムのプロバイダーに課される義務が定められています。

(a)「許容できないリスク」のAIシステム:

AI法はEU域内における「許容できないリスク」のAIシステムの市場投入、サービス開始、利用を禁止しています。このカテゴリーには、いくつかの例外を除き、以下のようなEUの価値観や基本的権利を侵害する「許容できないレベルのリスク」をもたらすAIシステムが含まれます:

-自然人の脆弱性を悪用し、もしくは、サブリミナル、操作的、または欺瞞的技術を利用するAIシステム;

-公私にわたるソーシャルスコアリングを行うAIシステム;

-自然人のプロファイリング情報のみに基づいて犯罪リスクを評価・予測するAIシステム;

-インターネットまたは監視カメラから無作為にスクレイピングした顔画像を用いて、顔認識データベースを作成するAIシステム;

-職場や教育機関において自然人の感情を推測するためのAIシステム;

-自然人の生体測定分類または識別を行うAIシステム;

-法執行の目的での、公共の場における自然人のリアルタイム遠隔生体認証識別。

(b)「高リスク」のAIシステム:

AI法は、上市前の適合性評価の義務を含め、「高リスク」のAIシステムに厳しい要件と義務を課しています。

AI法は、「高リスク」のAIシステムを健康、安全、または自然人の基本的人権に重大な危害を及ぼす可能性のあるAIシステムであると説明しています。「高リスク」のAIシステムは、原則として以下のように規定されています:

-AI法附属書ⅠのEU整合法令法が適用される製品の安全措置として使用され 、当該法に基づく第三者による適合性評価を受ける必要があるAIシステム 。

-AI法の附属書IIIに規定された8つの特定分野に該当するAIシステム :

・禁止されていない生体認証

・重要なインフラ

・教育及び職業訓練

・雇用、労働者管理、自営業へのアクセス

・必要不可欠な公共・民間サービスへのアクセスと享受・法執行

・移民・亡命、国境管理

・司法の運営と民主的なプロセス

第二のカテゴリー(すなわち付属書IIIの8分野)に該当するAIシステムについては、一定の限定的に定められた例外が適用されますが、個人をプロファイリングするAIシステムは常に高リスクとみなされ、厳格な要件の対象となります。

「高リスク」のAIシステムの提供者は、以下を含む厳しい義務を果たす必要があります 。:

-「高リスク」のAIシステムに対する広範な要件が、AIシステムのライフサイクルを通じて満たされるようにする必要があります。そのような要件には以下が含まれます。

・リスク管理システム・データガバナンス

・記録管理

・透明性と利用者への情報提供

・人間による監視可能性の確保

・正確性・安全性およびサイバーセキュリティの確保

-品質管理システムの確立の確保

-すべての関連技術文書の管理

-「高リスク」のAIシステムが自動生成したログの保管

-AIシステムの継続的な適合性を確保するための是正措置の採用

-提供者がEU域外にいる場合は、EU域内に設立された認定代理人を連絡担当者として任命

-「高リスク」のAIシステムがAI法第43条に基づく適合性評価手続を受けることの確保

-欧州アクセシビリティ法の要件への準拠の確保

-管轄当局への協力

また、利用者、輸入者、流通事業者といったその他の事業者も、AI法に定められた義務を果たさなければなりません。たとえば、利用者の義務には、以下が含まれます:

-適切な技術的・組織的な措置の実施

-適切な訓練と能力を備えた人間による監督の実施

-使用説明書に基づいた「高リスク」のAIシステムの運用および監視の確保

-「高リスク」のAIシステムの操作ログの少なくとも6ヶ月間の維持

-「高リスク」のAIシステムから得られた結果によって影響を受ける可能性のある個人(従業員など)に、AIシステムの利用の通知

-利用者が公的機関の場合、関連する登録要件に従う

-データ保護影響評価を実施するGDPRの義務の遵守

-関係当局への協力

(c)「限定リスク」のAIシステム:

AIシステムはユーザーと直接相互作用したり(チャットボットなど)、「ディープフェイク」を構成する映像や音声のコンテンツの生成や操作に関わることがあります。このような利用は、限定的なリスクをもたらすことがあるため、透明性と開示義務の対象となります 。

「限定リスク」のAIシステムに関連する透明性要件および適用される例外は、AI法第50条に規定されています:

提供者の透明性要件:

-自然人と直接相互作用することを意図したAIシステムは、個人がAIシステムと相互作用していることを知らされるような方法で設計・開発されることを保証するものであること。

-合成音声、画像、映像、テキストコンテンツを生成する際のシステムのアウトプットが、機械可読形式でマークされ、人為的に生成または操作されたものであることを検出できるようにすること。このような技術的解決策は、効果的で相互運用性があり、安全で信頼できるものでなければならない。

利用者の開示義務:

-ディープフェイクを構成する画像、音声または映像コンテンツを作成または編集する際に、システムの出力が人為的に生成または操作されたものであることを開示すること。

-公共の利害に関する事項を公衆に知らせる目的で公表された文章を作成またはその他の方法で修正する場合、システムのアウトプットが人為的に生成または操作されたものであることを公表すること。

-「高リスク」のAIシステムとして認定される可能性がある感情認識や生体認識分類システムにさらされた個人に情報提供をすること。

(d)「最小リスク」のAIシステム:

上記のカテゴリーに該当しないその他のAIシステムは「最小リスク」のAIシステムであり、リスクが最小限またはゼロであるため規制の対象とはなりません(例:スパムフィルター)。「最小リスク」のAIシステムは、さらなる制限や義務付けなしに導入することができますが、透明性、人間による監視、正確性など、規制対象となる「高リスク」のAIシステムに課される要件に自主的に従うことが推奨されています。

IV.「汎用目的型AIモデル」GPAIモデル:

AI法は「汎用目的型AI(GPAI)モデル」の利用を規制しています。「汎用目的型AI(GPAI)モデル」とは、「大規模な自己監視を使用して大量のデータで学習されたAIモデルを含み、そのモデルが市場に投入される前に研究、開発またはプロトタイピング活動に使用されるAIモデルを除き、そのモデルが市場に投入される方法に関係なく、重要な汎用性を示し、広範囲の明確なタスクを適切に実行でき、様々な下流のシステムやアプリケーションに統合できるAIモデル」と定義されています。

GPAIモデルの利用は、「システミック・リスク」をもたらすGPAIモデル提供者に加重された義務を課す段階的アプローチによって規制されます。

GPAIモデルのすべての提供者は、以下の義務を果たさなければならないとされています :

・モデルの技術文書を作成し、定期的に更新する;

・GPAIモデルをシステムに統合する予定のAIシステムの提供者向けの文書を作成し、更新する;

・EU著作権法および関連する権利を遵守するための方針を確立する;

・学習に使用されたコンテンツの詳細なサマリーを一般に公開する;

無償かつオープンライセンスの GPAI モデルについては、GPAI モデルが「システミック・リスク」を提示する場合を除き、無償かつオープンソースライセンスの下で一般に公開され、そのパラメータが公開されている GPAI モデルの提供者には、後者2つの義務のみが適用されます。

上記の義務に加え 、「システミック・リスク」を有するGPAIモデルの提供者は、以下の追加的な義務を果たさなければならないとされています。このような「システミック・リスク」は、そのトレーニングに使用される計算量の累計が1025 FLOPs(フロップス(浮動小数点演算速度))を超える場合に認められます :

・標準化されたモデルの評価を行う;

・潜在的な「システミック・リスク」を評価し、軽減する;

・重大インシデントと可能な是正措置の追跡と報告;

・適切なレベルのサイバーセキュリティ保護を確保する。

「システミック・リスク」を有する GPAI モデルの提供者は、整合化された基準が公表されるまで、準拠を実証するための実施基準に依拠することができます。かかる実施基準への準拠は、適合の推定につながります。AIオフィスは、GPAIモデル提供者、関連する各国所轄官庁に対し、EUレベルでの実施規範の作成に参加するよう要請することができます。

V.新しい統治機構:

AI法は、規制を適切に実施することを目的として、EU AIオフィス、独立専門家からなる科学委員会、AI委員会、利害関係者のための諮問フォーラムなどの新たな管理機関を設立しています。

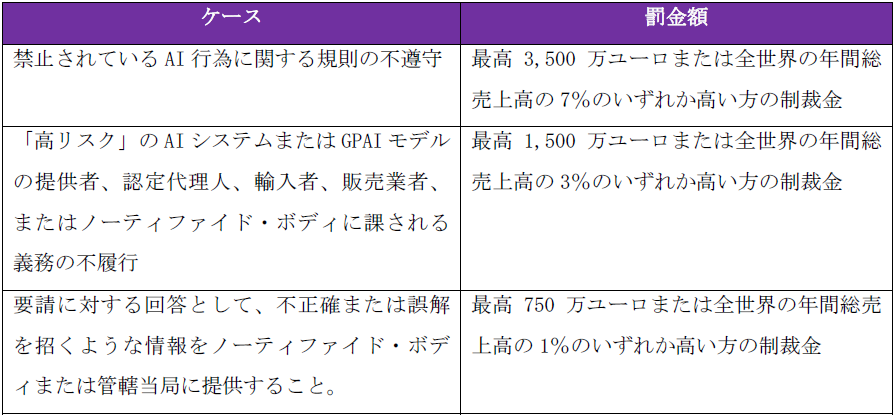

VI.罰則:

この規則に従わない場合、罰則が適用されます。罰則額は、違反した義務の種類によって異なり、具体的には以下のように定められています。:

上限額の罰金適用については例外があり、中小企業の場合、いずれか低い金額の罰金が科されます。

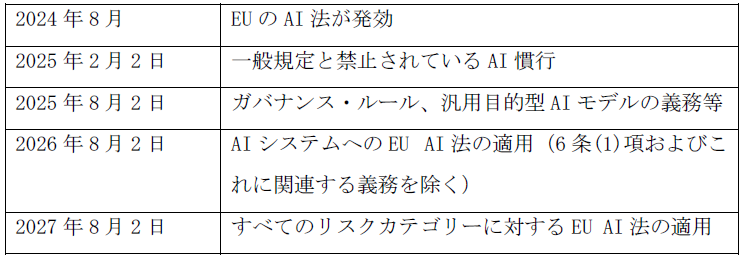

VII.AI法適用のタイムライン:

EUのAI法は、2024年8月1日にEU加盟27カ国すべてで発効されました。本規定は、以下のタイムテーブルに従って適用されます:

VIII.AI法が日本企業に与える影響とは?

上記で説明したように、AI法はEUの国境を越えて適用される可能性があり、そのような場合、同法第22条により、EU域外に設立された「高リスク」のAIシステムの提供者に対し、そのシステムをEU市場で販売する前に、書面による委任によりEU域内に設立された認定代理人を任命するよう求められます。同法第22条は、EU域外に設立された高リスクのAIシステムの提供者に対し、EU市場でそのシステムを利用可能にする前に、書面による委任によりEU域内に設立された認定代理人を任命することを義務付けています。EU域内でAIシステムを開発、作成、使用、またはそのようなサービスを提供する日本企業は、AI法の導入がもたらす潜在的影響の評価を開始する必要があります。

具体的には、以下のような対応が考えられます。:

-AI法に記載されているカテゴリーに従って、使用されているAIシステムの種類を特定し、カタログ化する;

-EUのAI法の適用範囲が広いことを考慮し、事業者によるAIシステムの利用が同法の適用範囲に含まれるかどうかを評価する;

-社内外のAIシステムがもたらす具体的なリスクを理解し、役割(提供者、利用者)など)と使用するAIシステムとの関連で満たすべき要件を理解する;

-ギャップ分析を実施し、コンプライアンス違反の領域を特定する;

-AIアプリケーションの意味について従業員を教育・訓練する;

-EUのAI法の要件に正しく対応するため、関係者とコミュニケーションを図る;

最後に、AI法はAIシステムのリスクと展開に特に対処することを意図していますが 、GDPR、消費者保護、知的財産権法など、企業が考慮する必要のある他の多くの規制の枠組みがあることに留意が必要です。したがって、AI法を具体的に遵守する一方で、企業は既存の法的枠組みの下での他の義務を忘れてはならないことを理解することが重要です 。

コンタクト

荒木 昭子 (Akiko Araki)

カリフォルニア州弁護士、弁護士、弁理士

akiko.araki@arakiplaw.com

CV:https://arakiplaw.com/our-people/araki/

ラウラ・コロンビーニ

(Laura Colombini)

パラリーガル

laura.colombini@arakiplaw.com

CV:https://arakiplaw.com/our-people/colombini/

[荒木法律事務所について]

荒木法律事務所(Araki International IP&Law)は、2021年にグローバル・ファーム及び日本の国内ファーム等で10年以上の経験を有する弁護士によって創設された法律事務所です。特に、知的財産分野のクロス・ボーダーのライセンスや国際的な紛争解決の分野に力を入れています。その他、国際取引・紛争解決、データ・プライバシー、IT・情報通信、規制対応・コンプライアンス等、幅広い領域において企業をサポートいたします。 本ニュースレターは、当事務所のクライアントの皆様、当事務所所属弁護士と名刺交換させていただいた皆様、及び、当事務所が主催又は後援するイベントにご参加いただいた皆様宛てに、一般的な情報提供を目的としてご案内しております。本レターが法的アドバイスを構成するものではないことにご留意ください。配信を希望される場合、その他お問合せにつきましては、お手数ですがメールでご連絡ください。